聊聊自动系统的安全设计需求

1赞前阵子网上有个《特斯拉Model X用户教你怎样正确使用自动驾驶功能》,这个确实有些滥用这个功能的嫌疑,当然我们认为这个视频更多的还是搞笑的。

在Youtube找了一下,Tesla的Autopilot确实有滥用的方法,但是也有好的方面。

1)司机在里头睡觉

2)AEB的实际使用效果

3)横向方面运动的调整

我们探讨这个事,其实是需要系统工程师在未来确定,L2&L3系统本身的需求,特别是处理功能安全需求的实际分解情况。

传统车企其实考虑的事情要多很多,你需要告诉你的客户你的产品在什么时候能工作,什么时候不行

在测定环境、道路情况还有驾驶员的行为的时候,耗费很多的时间精力;到L2&L3,大部分驾驶员的行为需要在特定模式下的程序代替

当程序出现Bug或者硬件出现bug,L2&L3其实将很大一块的责任也包在车内了

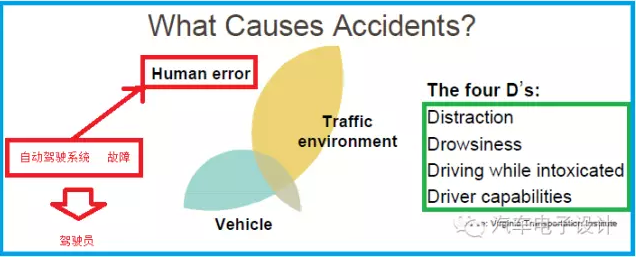

未来L2&L3的系统会代替人类犯错误,这里涉及到故障内容包括,参考文献《Failure Diagnosis and Prognosis for Automotive Systems》

故障

ADAS感知传感器本身的故障

这里包括对外界环境的错误

也包括在环境条件下传感器本身的工作不正常

通信问题

在总线范围内,和安全相关消息的传递情况

ECU本身的问题

执行器(加速、刹车和EPS)三个问题

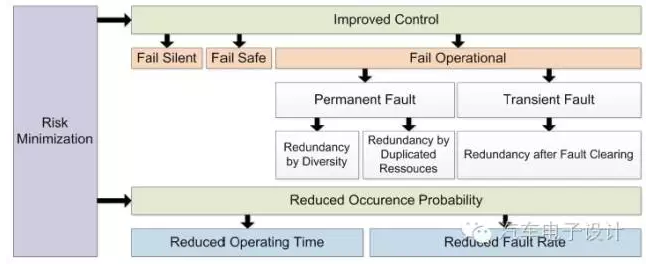

前两天和金兄谈到的Fail-Operational的东西,我们需要考虑情况这方面的考虑,然后对原有的功能等级进行评估。

再早之前写的EPS文章,陈林兄对EPS的故障等级表示一些异议,不过如参考文献中所言,《Development and Future Outlook of Steering Systems》应用环境的PHA进行定义是出发点。

Driver一旦不介入,转向过大、过小甚至没有安全等级全是很危险的(D)。

如果我们真的将整块系统纳入系统安全的分析来说,评估故障发生引起的问题的时候,我们大概需要对整个系统进行重新梳理,特别是执行部分。

明天我们重点和金工一起谈谈这个Fail-Operation的EPS设计

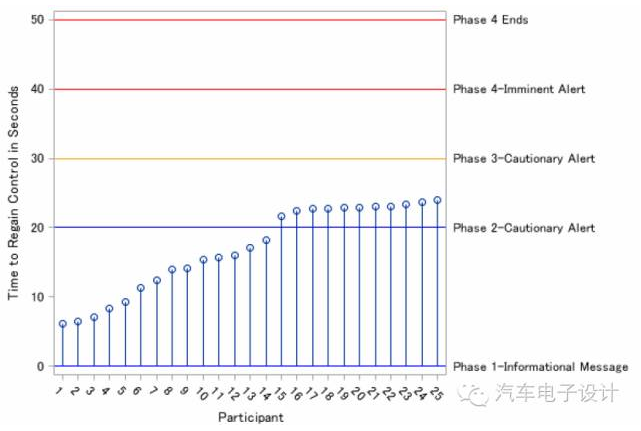

最后,一旦允许驾驶员离手方向盘瞎来,DOT资助的项目挺有趣的,用了不少摄像头来确认驾驶员什么时候可以被HMI的警告回来,整个系统需要挺10~20s以上。

小结:

1)ADAS是好东西,但是对ADAS能力认知错误也容易付出代价,我们可以从正向和负向来看这个问题

2)我现在自己有空的时候,把一些实验结论导入到系统需求里面,也会对不同系统的(原有和将来)规范做对比,高阶ADAS的需求本身对原有产品的性能和安全等级都有了提高的要求